有關AI工具的3個數據

-

#近80%香港青年曾使用生成式AI工具

-

#去年全球有超過10萬個ChatGPT用戶的資料外洩

-

#有騙徒成功利用AI換臉程式假冒身份騙取7萬元

個資被聊天程式儲存

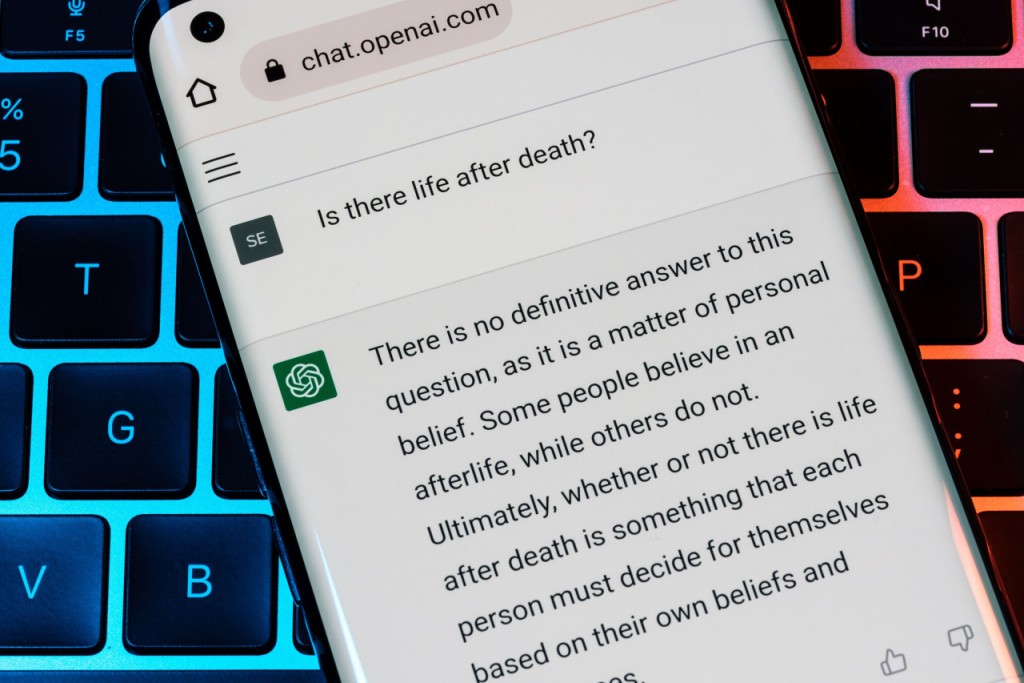

近年生成式人工智能(AI)及聊天機械人崛起,例如ChatGPT、Bard、文心一言等,成為不少市民及企業的「福音」,惟用戶使用時或在無形中洩漏個人私隱及敏感資料,引起全球各地及不同行業關注。

生成式AI是基於「深度學習」技術,通過「學習」龐大原始數據生成新數據,當中或涉及機密或敏感的個人資料,例如身份證號碼、財務資料等,均有可能被儲存到人工智能工具的訓練資料庫中,並根據演算法提供予其他用戶使用,增加資料外洩風險。去年6月至今年5月期間,亞太地區便有超過4萬個ChatGPT用戶的資料外洩,大部分個案因帳號裝置接觸帶有竊密的惡意程式,導致用戶資料被盜並遭轉售圖利。

此外,早於2008年,英國倫敦大學一份研究已將深度偽造技術(Deepfake)評級為最具威脅的人工智能犯罪隱患。由於近年應用深度偽造技術的應用門檻不斷降低,生成的資料及成品幾可亂真,近期更有不法之徒利用人工智能換臉程式冒認已報失身份證的市民,成功騙取巨額貸款及開設銀行戶口,可見人工智能騙局令人防不勝防!

相關新聞:中國發展高層論壇︱人工智能逾10億參數模型 中國已擁逾百個

要「自保」建防禦意識

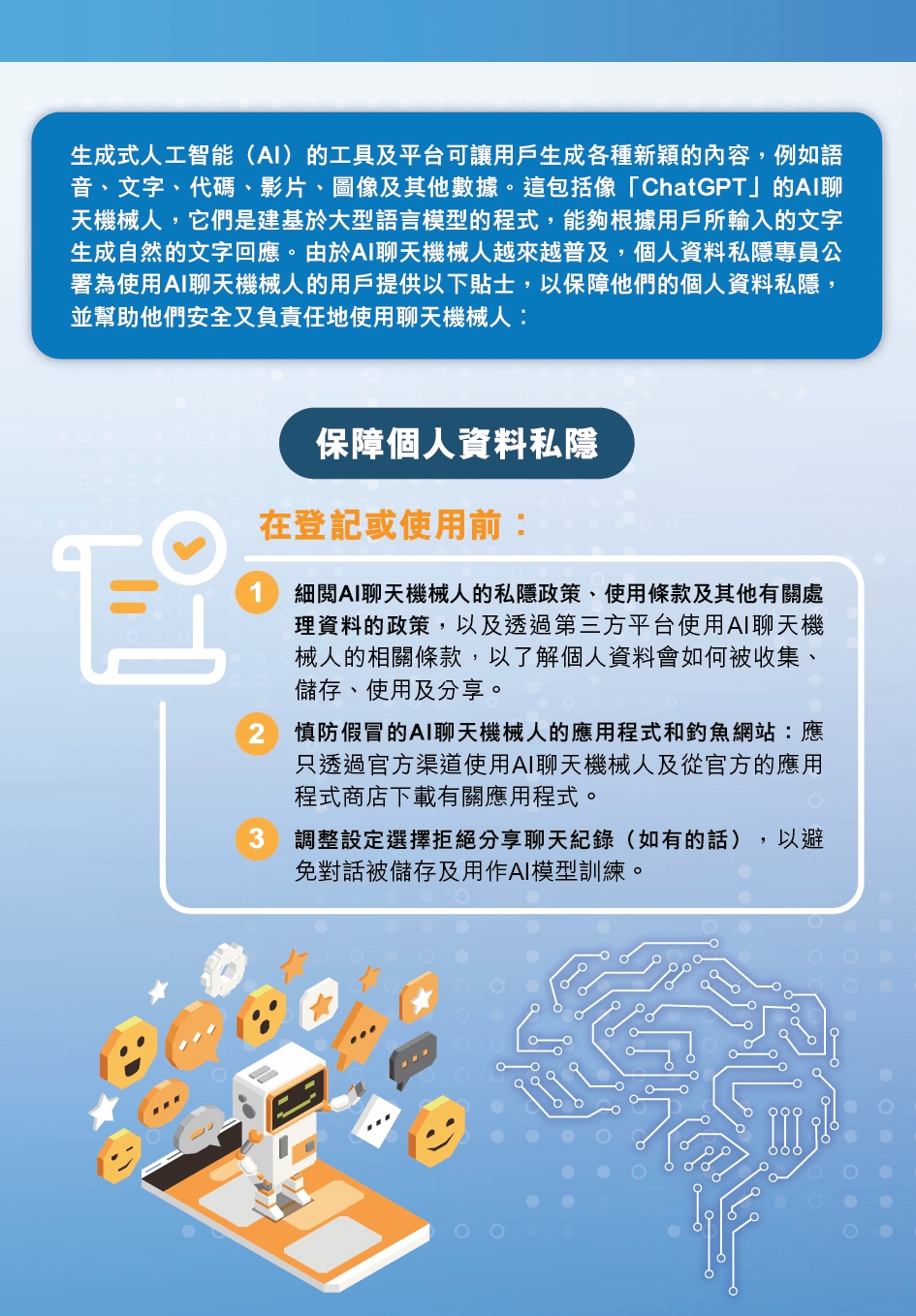

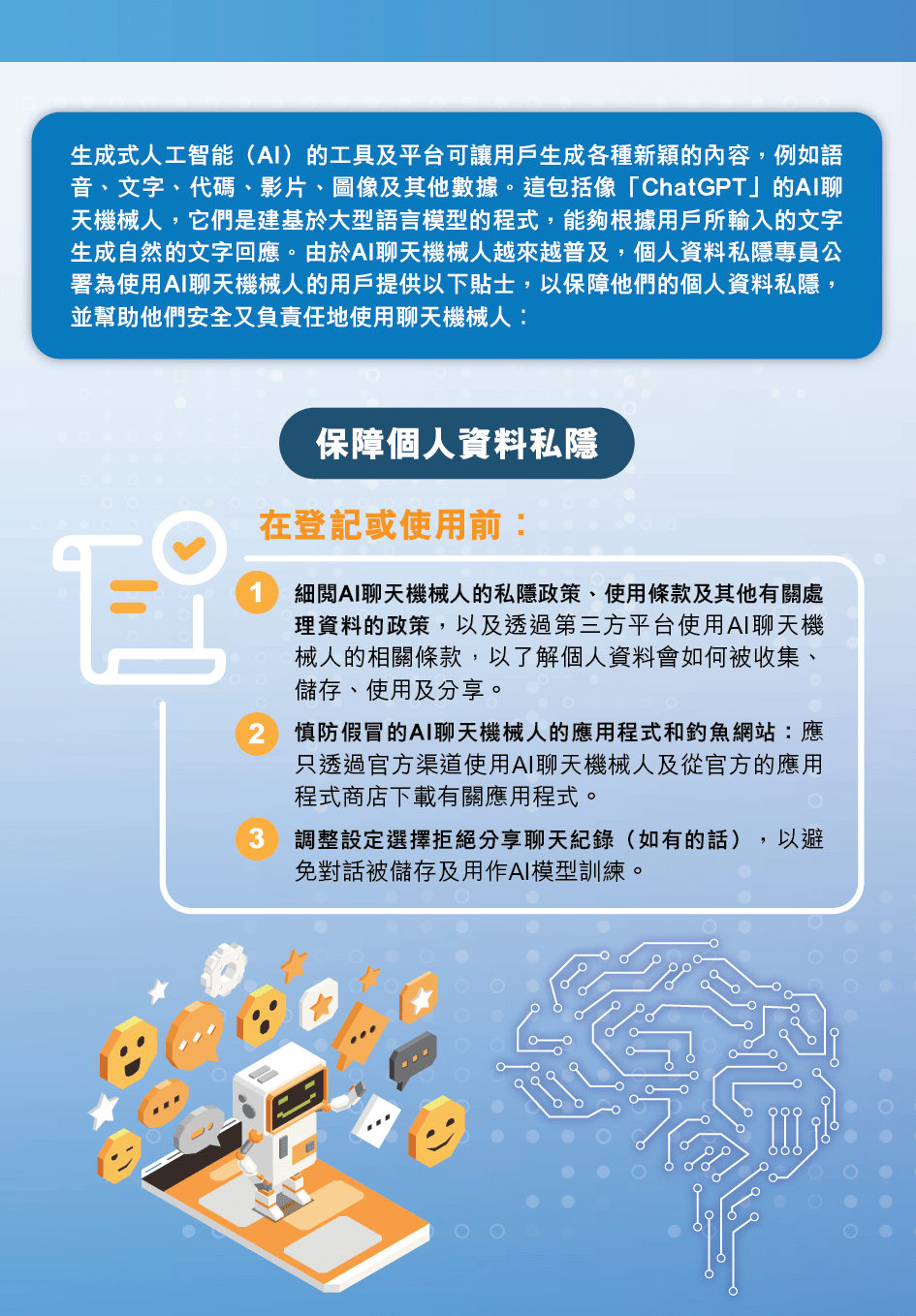

生成式人工智能工具越趨普及,帶來私隱及資料外洩及被濫用的隱患,全球多國亦正研究通過立法及規管等措施減輕私隱及道德風險。本港方面,私隱專員公署早於2021年發布人工智能國際性道德標準指引,如行為監督、問責性、私隱保障等,近日更特別推出《使用AI聊天機械人「自保」十招》,冀市民能慎用這項變革性技術,保障個人資料私隱。

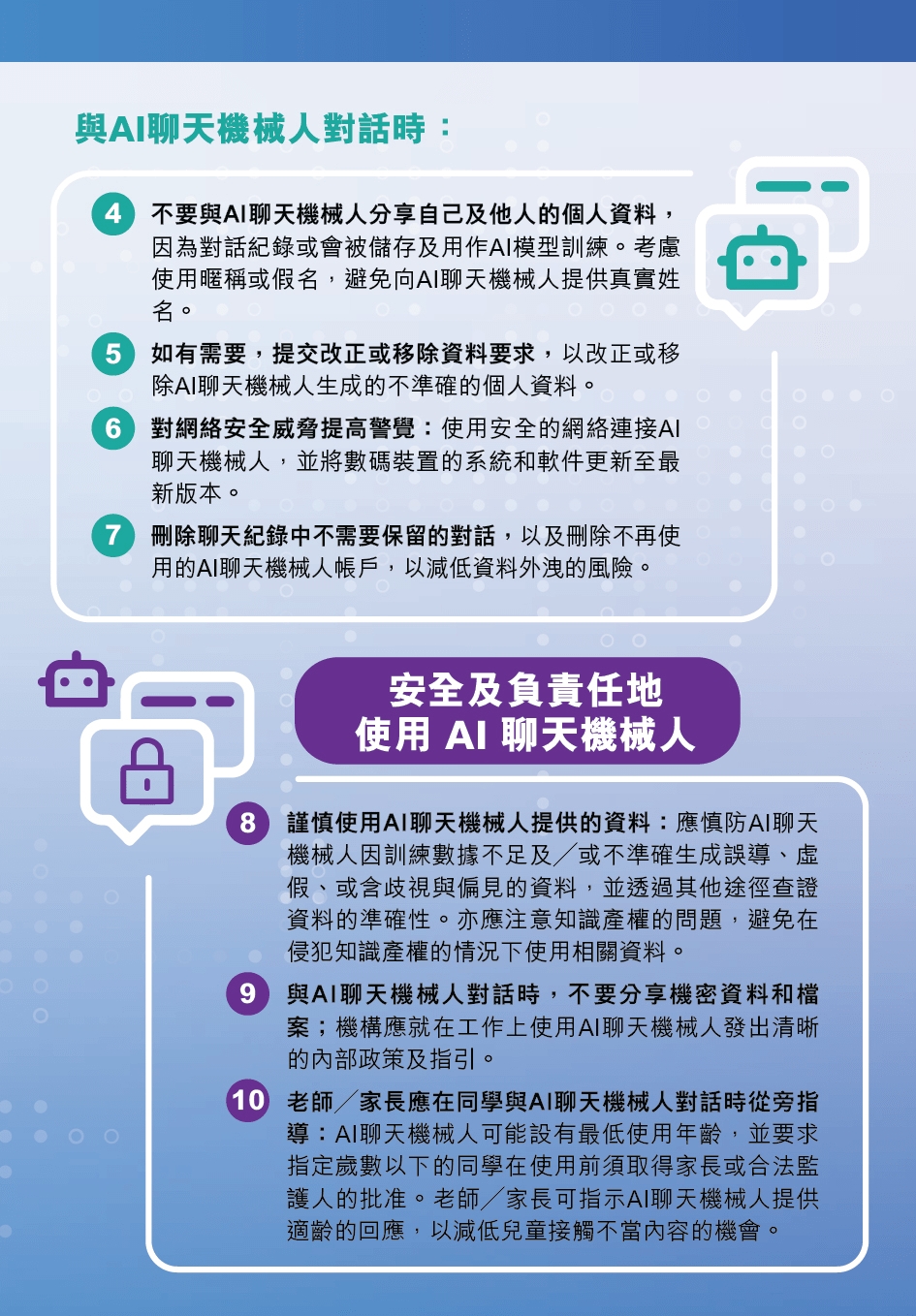

首先,大眾在登記或使用相關程式前應細閱私隱政策,慎防假冒的AI聊天機械人及惡意應用程式、網站等,以免墮入欺詐陷阱。此外,AI聊天機械人依靠原始數據建構對答內容,稍有不慎則會洩漏私隱,因此在對話過程中,應避免分享個人敏感資料,包括姓名、職位、住址等,同時刪除不必要的聊天記錄或移除資料,減低資料外洩風險。

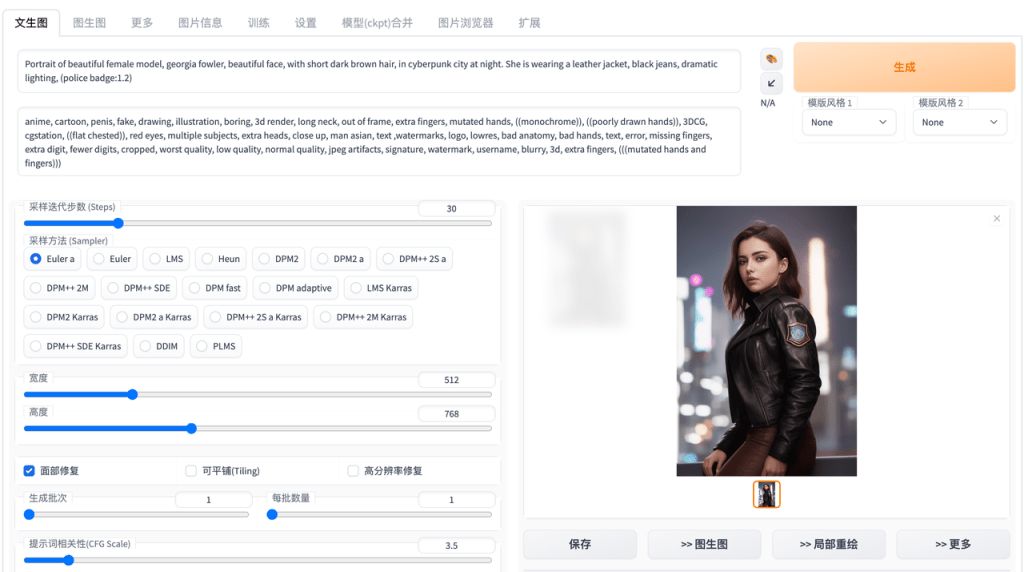

生成式人工智能技術的訓練數據亦涉及道德問題,其生成的內容或帶有現實世界的歧視、偏見,例如種族、性別歧視等,甚至因訓練不足而出現虛假或不準確的資料,因此大眾在使用相關資料時應明辨慎思,從不同途徑查證資料真確性及避免侵犯知識產權。

科技發展一日千里,大眾應時刻保持網絡安全防禦意識,同時安全及負責任地應用相關技術及工具,建立符合人類福祉的人工智能生態系統。

相關新聞:專訪│使用聊天機械人有個人資料外洩風險 私隱專員公署教你十招自保

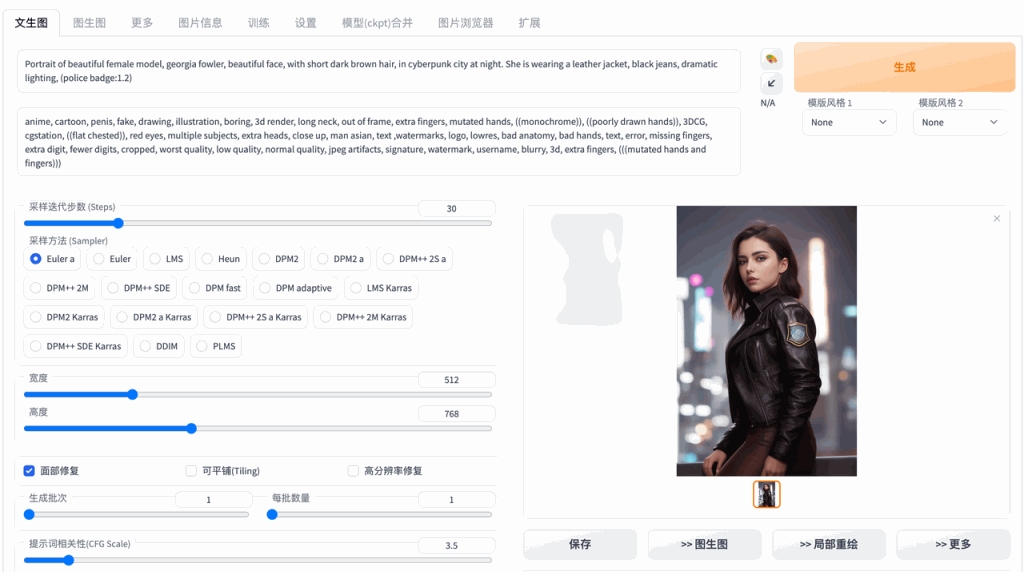

生成式人工智能 Generative Artificial Intelligence

通過演算法學習大量數據,從而生成與原始數據相似的新數據,可助用戶生成各種創新內容,例如文本、圖像、語音、多媒體、代碼等新數據。

深度偽造技術 Deepfake

指利用深度學習進行影像合成,偽造影像或語音,是人工智能的技術之一,相關技術只須擷取部分語音或影像數據,便可模擬出新數據。

文:小斯;圖:星島圖片庫、網上圖片、《使用AI聊天機械人「自保」十招》、Amazon Web Services(AWS)、安全內參

相關文章:

- DSE備戰公民科|資訊素養—假新聞又快又多 宜核實網上資訊

- DSE備戰公民科|資訊素養—跨行 即時 跨境 轉數快打破傳統支帳限制

- DSE備戰公民科|資訊素養—Threads用戶暴跌 新興應用維持熱度不易

- DSE備戰公民科|資訊素養—從JPEX案 認識加密貨幣

《星島頭條》APP經已推出最新版本,請立即更新,瀏覽更精彩內容:https://bit.ly/3yLrgYZ