人工智能(AI)技術的急速發展最近成為各界關注焦點。人們對於AI將來會在哪方面對人類構成威脅,以至美國國防部五角大廈是否一直在「在地下室建造AI殺手機械人」都有各種猜測。而就在此背景下,西方媒體近日報道,美國防部正推出技術防止AI殺手機械人在戰場上因「視覺噪音」而失控。

報道稱,美國五角大廈官員對「人工智能或自主系統的獨特漏洞類別」已經敲響了警報,他們希望新的研究能解決這些問題。據悉,美國一項名為「保證人工智能穩健性免受欺騙」(GARD)的計劃,致力於識別人工智能的視覺數據或其他電子訊號輸入,可能如何因引入所謂的「視覺噪音」(visual noise)而受影響。正如一位管理該研究的五角大樓高級官員周三解釋稱,「本質上,透過向影像或感測器添加噪音,也許可以破壞下游機器學習演算法」。

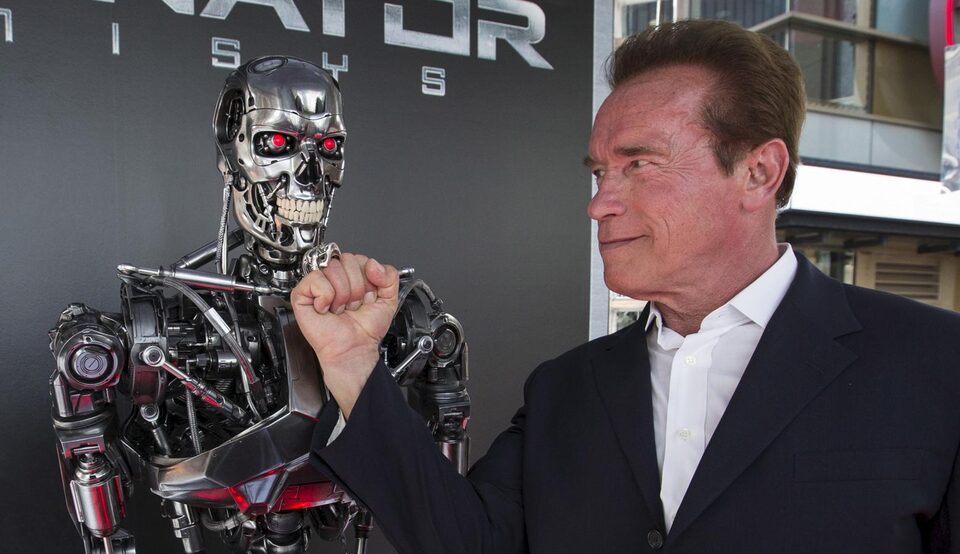

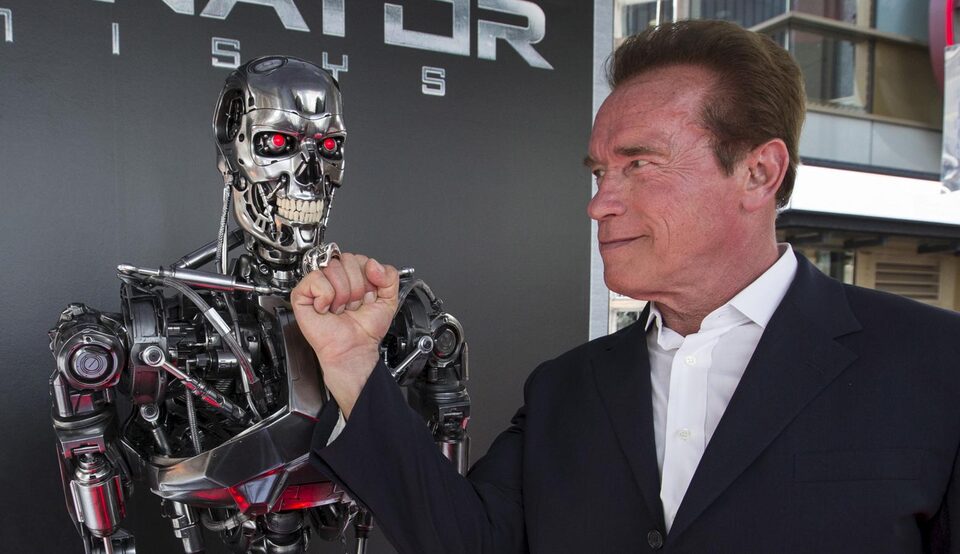

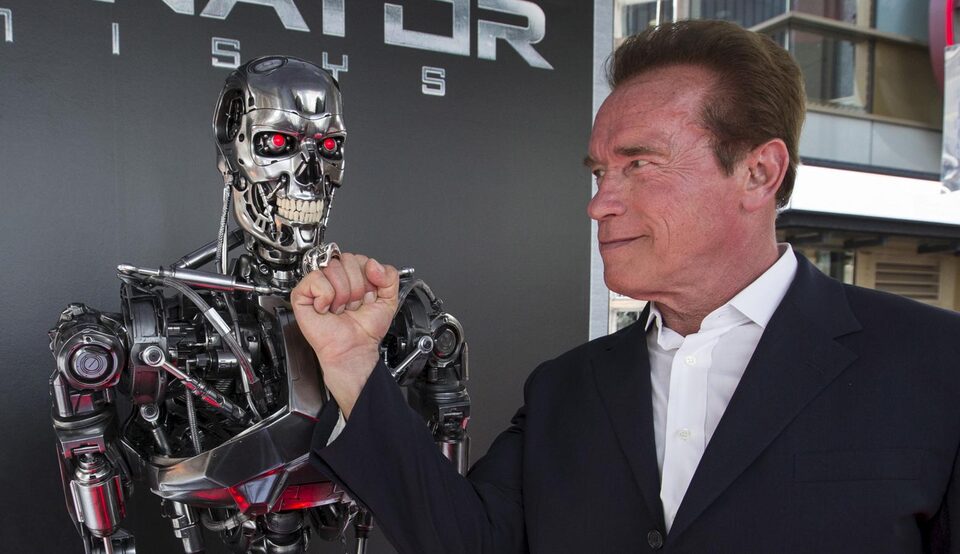

電影《未來戰士》中一類殺手機械人未來有可能成真。路透社

德國柏林早前有示威者集會要求勿發展殺手機械人。路透社

德國柏林早前有示威者集會要求勿發展殺手機械人。路透社

電影《未來戰士》中一類殺手機械人未來有可能成真。路透社

電影《未來戰士》中一類殺手機械人未來有可能成真。路透社

GARD國防承包商之一的電腦科學家,已經為測試此潛在問題嘗試了各種各樣的補丁。國防承包商MITRE公司的電腦科學家成功創造了「視覺噪音」。例如,一輛滿載平民的巴士,如果被貼上了「視覺噪音」標籤,可能會被人工智能誤認為是一輛坦克。

從技術上而言,「欺騙」人工智能演算法犯下關鍵任務錯誤,是可行的。

而透過「保證人工智能穩健性免受欺騙」的計劃,該機構持續在與行業合作夥伴合作開發演算法和其他功能,來阻止此類欺騙行為。

美國國防部高級研究計畫局(DARPA) 資訊創新辦公室副主任圖雷克稱:「這是一個專注於建立防禦人工智能系統對抗性攻擊的計劃。」「無論是物理上可實現的攻擊,還是添加到人工智能系統中的噪音模式,GARD計畫都針對這些攻擊建立最先進的防禦措施。 」